W tym tygodniu Sąd Najwyższy wreszcie rozpatrzy sprawy dotyczące treści o charakterze terrorystycznym w mediach społecznościowych. Dla tych, którzy badali ten problem, rozpatrzenie ich zabrało bardzo dużo czasu. W styczniu 2015 r. artykuł w Forbes zatytułowany „Terrorystyczne wykorzystanie amerykańskich mediów społecznościowych stanowi zagrożenie dla bezpieczeństwa narodowego”, prezes Middle East Media Research Institute (MEMRI), Yigal Carmon i ja, napisaliśmy o potrzebie podjęcia przez rząd USA działań, zauważając, że „rozwiązania mogą wymagać zbadania przez ekspertów prawa konstytucyjnego i być może będą musiały przejść całą drogę do Sądu Najwyższego”.

MEMRI zaczął monitorować wykorzystanie Internetu przez terrorystów w 2006 roku. W 2010 roku odkryliśmy, że YouTube stała się wiodącą witryną internetową dla dżihadu online. Napisałem wiele raportów na temat wpływu obecności na YouTube Al-Kaidy i grup dżihadystycznych na Zachodzie, w tym szybko rosnącej liczby młodych ludzi Zachodu, których treści dżihadystyczne inspirowały do aktów terroryzmu.

20 grudnia 2010 r., kiedy te doniesienia były omawiane w mediach i na Kapitolu, spotkałem się na zaproszenie Google z czterema ówczesnymi starszymi przedstawicielami Google, szefem działu Public Relations & Policy; starszym kierownikiem ds. polityki; starszym radcą ds. polityki i czwartym członkiem zespołu, radcą ds. wolności słowa – w biurze firmy w Waszyngtonie, aby omówić badania MEMRI na YouTube i filmy dżihadystów.

Znaczna część spotkania koncentrowała się na nagraniach wideo jemeńsko-amerykańskiego przywódcy Al-Kaidy, Anwara Al- Awlakiego, niezwykle wpływowego szejka dżihadysty, który osobiście udzielał wskazówek dotyczących ataków przeprowadzonych przez Nadala Hasana i Umara Farouka Abdulmutallaba w 2009 roku. Hasan, wojskowy psychiatra, zabił 13 osób podczas strzelaniny w Fort Hood w Teksasie, a Abdulmutallab próbował wysadzić w powietrze samolot lecący do Detroit w Boże Narodzenie za pomocą materiałów wybuchowych w bieliźnie. Wiadomo było, że filmy Al-Awlakiego były oglądane przez dżihadystów, którzy dokonywali aktów terroru – na przykład niedoszli zamachowcy z Fort Dix z 2008 roku, którzy zostali skazani za spiskowanie w celu zabicia amerykańskich żołnierzy w bazie wojskowej w New Jersey. Na spotkaniu dyskutowano także o innych filmach, które zostały zarekomendowane jako wymagające usunięcia z YouTube.

Razem z przedstawicielami Google obejrzeliśmy „Soldiers of Allah [Żołnierze Allaha] Imama Anwara Al-Awlakiego”, kazanie Al-Awlakiego na YouTube. Pokazałem im również, o co właściwie chodzi w obecnej sprawie w Sądzie Najwyższym – w jaki sposób podczas oglądania filmów dżihadystycznych algorytm platformy polecał podobne filmy z innych kont YouTube – w tym dziesiątki innych filmów Al-Awlakiego i innych filmów Al-Kaidy poświęconych konkretnie dżihadowi i prezentujących ich ikonografię.

Przedstawiciele YouTube’a powiedzieli, że wideo „Żołnierze Allaha” nie zostanie usunięte – ponieważ było to „legalne wideo religijne”, które nie jest „koniecznie” związane z dżihadem, mimo że było autorstwa Al-Awlakiego. Według przedstawicieli Google algorytmiczna promocja innych filmów dżihadystycznych nie była ich zmartwieniem; nie było warte ich czasu.

Prośba Google o to spotkanie pojawiła się w następstwie złej prasy po londyńskiej próbie zamordowania posła Stephena Timmsa przez Roshonarę Choudhry w maju 2010 roku . Stwierdzono, że ściągała on z Internetu materiały Al-Awlakiego – które, jak zauważyły media, były szeroko dostępne na YouTube – i według własnych słów, uległa radykalizacji, słuchając jego wystąpień.

Odzwierciedlając rosnące oburzenie treściami terrorystycznymi na YouTube, we wrześniu 2010 r. kongresmen USA Ted Poe wraz z kongresmenami Ileaną Ros-Lehtinen, Edem Royce i Donaldem Manzullo napisali list do firmy na podstawie jednego z raportów MEMRI: wyrażając „głębokie zaniepokojenie” „rosnącym wzrostem liczby grup terrorystycznych korzystających z YouTube”. Podkreślili fakt, że według ostatnich raportów „YouTube stała się największym biurem informacyjnym, pokazującym filmy dżihadystów”. List kończył się pytaniem o strategię YouTube dotyczącą tych treści.

Pod presją Brytyjczyków i Amerykanów YouTube powiedziała „New York Times”, że usunęła niektóre filmy Al-Awlakiego zawierające wezwania do dżihadu, a także filmy naruszające wytyczne witryny zabraniające „konstruowania bomb, mowy nienawiści i podżegania” do przemocy lub przez „członka zagranicznej organizacji uznanej za terrorystyczną” lub promowania interesów grup terrorystycznych. YouTube dodała, że będzie nadal usuwała takie treści, ale podkreśliła, że „materiały o charakterze czysto religijnym pozostaną na stronie”. Należy zauważyć, że całe podżeganie Al-Awlakiego było „czysto religijne”.

Należy zauważyć, że nawet po jego śmierci w 2011 r. internetowe kazania Al-Awlakiego nadal inspirowały ataki – w tym, według ekspertów od terroryzmu, strzelaninę w San Bernardino w Kalifornii, w której zginęło 14 osób; zamach bombowy podczas maratonu bostońskiego, w którym zginęły trzy osoby, a ponad 260 zostało rannych; oraz zamachy bombowe w Nowym Jorku w 2016 r., w których 29 zostało rannych.

Obecnie Sąd Najwyższy rozpatruje dwie sprawy związane z terroryzmem, dotyczące sekcji 230 ustawy Communications Decency Act z 1996 r. Jedna sprawa, Gonzalez przeciwko Google, jest wnoszona przez rodzinę Nohemi Gonzalez, 23-letniej obywatelki amerykańskiej zabitej przez ISIS w Paryżu w listopadzie 2015 r. Rodzina twierdzi, że YouTube naruszyła ustawę antyterrorystyczną, gdy jej algorytmy polecały użytkownikom treści związane z ISIS, oraz że treści polecane użytkownikom przez algorytmy nie powinny być chronione przez sekcję 230. Druga sprawa, Twitter v. Taamneh, dotyczy tego, czy firmy mediów społecznościowych są odpowiedzialne za pomoc i podżeganie do międzynarodowego terroryzmu, gdy grupy terrorystyczne korzystają z platform mediów społecznościowych.

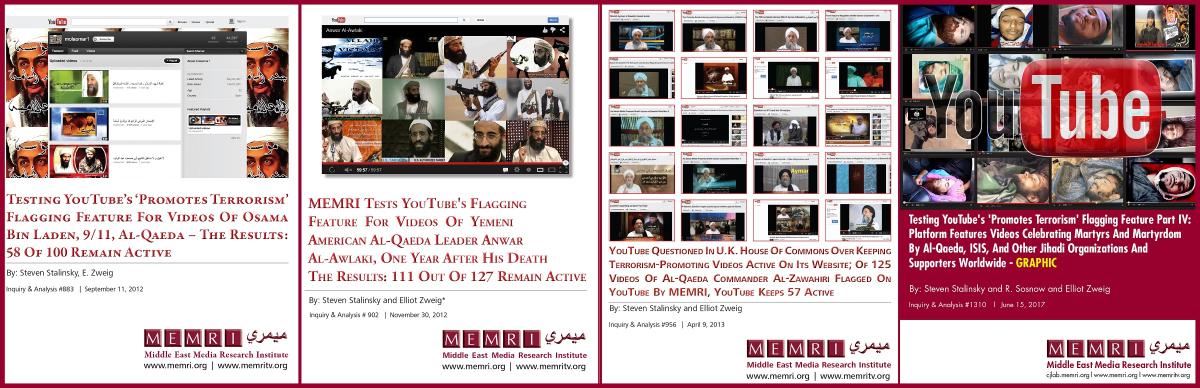

Po spotkaniu w grudniu 2010 r. nadal oferowaliśmy YouTube pomoc w identyfikowaniu filmów, które podżegają do przemocy i aktów terrorystycznych. Nowo utworzona funkcja YouTube oznaczania treści „promujących terroryzm” była testowana przez cały 2012 rok przez MEMRI Cyber & Jihad Lab (CJL), sztandarowy projekt, który od ponad 15 lat śledzi, bada i analizuje działalność terrorystyczną w cyberprzestrzeni, pomagając firmom technologicznym usuwać treści terrorystyczne.

Po oryginalnych raportach MEMRI, seria raportów z lat 2012-2017 na temat oflagowania filmów Osamy bin Ladena, 11 września, Al-Kaidy, Al-Awlakiego i świętowania ataków terrorystycznych pokazała, że większość treści pozostała online.

Od tego czasu YouTube dużo lepiej radzi sobie z usuwaniem materiałów związanych z dżihadyzmem i terroryzmem, a wiele moich sugestii zgłoszonych na spotkaniu w grudniu 2010 roku zostało wdrożonych. Jednak chociaż w języku arabskim jest mniej filmów dżihadystycznych, platforma udostępnia coraz więcej treści neonazistowskich, zwolenników białej supremacji i innych krajowych terrorystów w wielu językach europejskich. Brak skupienia się na usuwaniu takich filmów umożliwia wzrost tych ruchów.

Nie da się powiedzieć, ile szkód wyrządzono, pozwalając ekstremistycznym treściom nadal jątrzyć online przez osiem lat od naszego artykułu w Forbes. Chociaż istnieją obawy co do tego, co sąd może orzec, istnieje również duży potencjał dobrych ogólnych wyników dla platform, poza tymi wymienionymi w procesach sądowych – na przykład zmuszenie zaszyfrowanej aplikacji Telegram, powszechnie preferowanej zarówno przez dżihadystów, jak i krajowych ekstremistów, do usuwania brutalnych i ekstremistycznych treści.

Technologia może również pomóc – algorytmy mogą, oprócz wyświetlania widzom bardziej podobnych treści, pomóc ustalić, czy treść jest wolnością słowa, czy podżeganiem do przemocy. Choć niedoskonała, dokładność algorytmów będzie rosła z czasem.

W ciągu ostatnich kilku tygodni opublikowano niezliczone artykuły na temat sekcji 230 i przyszłości Internetu, które tak naprawdę nie rozumieją niebezpieczeństw związanych z treściami terrorystycznymi online. Zdecydowana większość ich autorów nigdy nie widziała w Internecie treści terrorystycznych, które ja i moja organizacja monitorujemy codziennie od 2006 roku. Martwię się również, że sędziowie Sądu Najwyższego nie są wystarczająco poinformowani w tej sprawie, aby móc podejmować decyzje dotyczące tego. Jak sędzia Elena Kagan powiedziała o konfuzji sędziów, do której sami się przyznają : „Jesteśmy sądem. Naprawdę nie znamy się na tych rzeczach. Wiesz, to nie jest tak, jak dziewięciu największych ekspertów ds. Internetu”.

Od 2015 r. (wydarzenia w sprawie Gonzalez przeciwko Google) i 2017 r. (wydarzenia w sprawie Twitter przeciwko Taamneh) główne firmy zajmujące się mediami społecznościowymi poprawiły monitorowanie treści terrorystycznych. Ale nadal muszą być pociągnięci do odpowiedzialności za swoją bezczynność, kiedy terroryści mieli wolną rękę na ich platformach. Potrzebne są branżowe standardy społeczności technologicznej przewidujące wykluczenie firm, w tym sklepów z aplikacjami, które nie przestrzegają standardów. Jeszcze bardziej potrzebny jest nadzór rządowy, z półrocznym raportem przedstawiającym rezultaty wysiłków tych firm w usuwaniu treści o charakterze terrorystycznym oraz surowe kary dla tych firm, które się do tego nie stosują. Należy również zauważyć, że sedno sprawy nie jest częścią dzisiejszych procesów sądowych – że brutalne treści nawołujące do zabójstwa mogą być opakowane w kontekst religijny i że wolność słowa nie może obejmować nawoływań do przemocy tylko dlatego, że pochodzą z religijnego źródła.

*Steven Stalinsky jest dyrektorem wykonawczym MEMRI (Middle East Media Research Institute), który aktywnie współpracuje z Kongresem i firmami technologicznymi w walce z cyberdżihadem za pośrednictwem Jihad and Terrorism Threat Monitor.